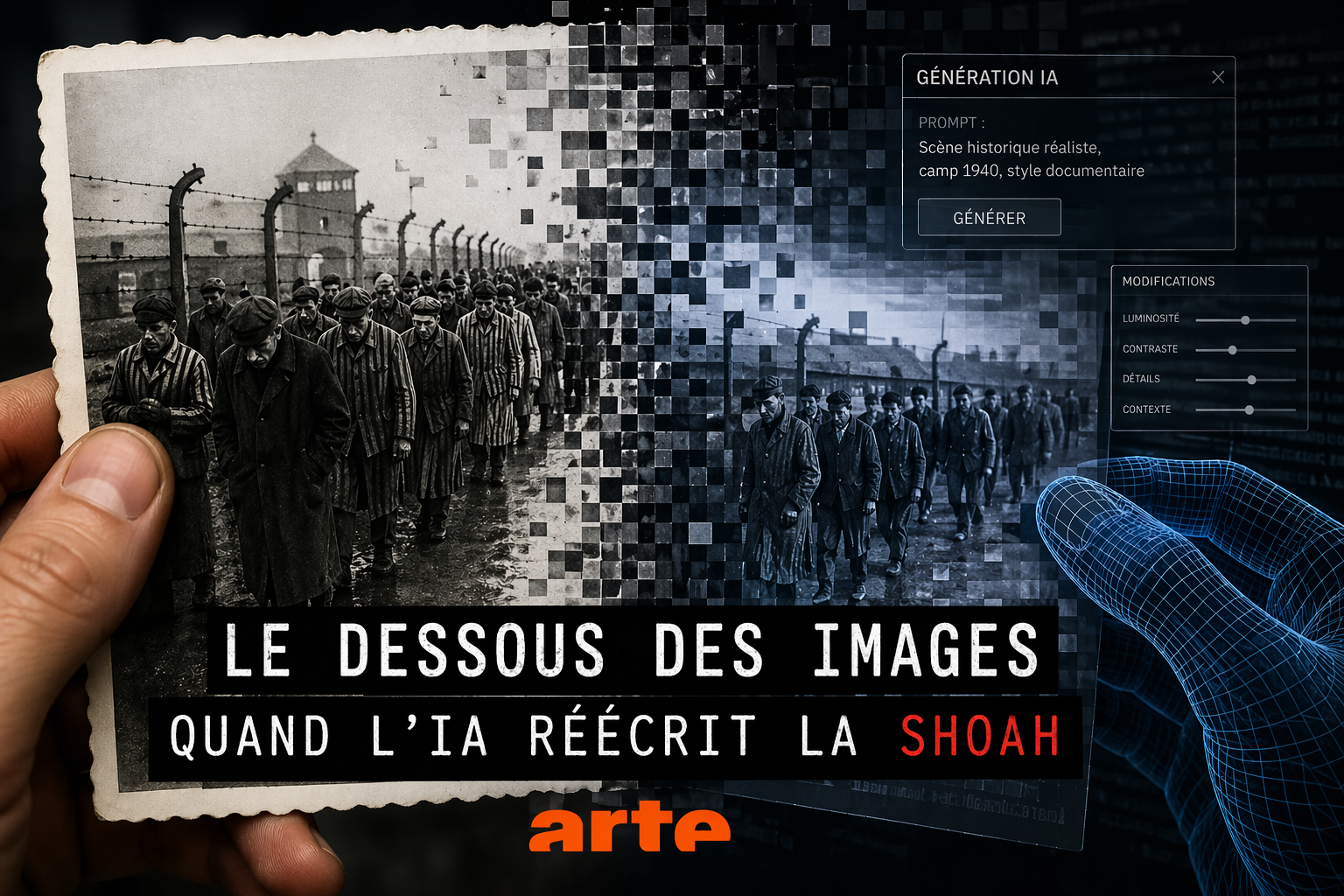

ARTE, Le dessous des images – Quand l’IA réécrit la Shoah.

Un homme joue du violon dans ce qui ressemble à un camp de concentration. Créée par l’intelligence artificielle à partir des codes de la photographie historique, cette image illustre une tendance qui questionne notre rapport aux images d’archives et à la mémoire de la Shoah.

« Au cours des derniers mois, les réseaux sociaux ont vu apparaître de plus en plus de contenus créés à l’aide de l’intelligence artificielle (IA) et liés au nazisme, qui ne représentent pas des événements historiques, mais sont purement fictifs. Ces contenus, communément appelés « AI-Slop », montrent par exemple des situations supposées dans des camps nazis ou lors de leur libération. Ils donnent une image extrêmement déformée et fausse de la réalité. L’intelligence artificielle est ici utilisée pour créer des contenus composés d’éléments tirés de faits historiques et de fictions émotionnelles.

Derrière ces contenus, se cachent différentes motivations : d’une part, les « fermes de contenu » exploitent la charge émotionnelle de l’Holocauste pour obtenir une portée maximale avec un minimum d’efforts. Un modèle commercial basé sur les clics et les recettes publicitaires. D’autre part, ces contenus sont utilisés de manière ciblée pour diluer les faits historiques, inverser les rôles des victimes et des bourreaux ou diffuser des récits révisionnistes. Les algorithmes des plateformes favorisent les contenus chargés d’émotion, indépendamment de leur véracité.

En tant qu’institutions d’éducation historique et politique, nous observons cette évolution avec une grande inquiétude. Les contenus générés par l’IA faussent l’histoire en la banalisant. Ils modifient les habitudes visuelles des utilisateurs, qui remettent de plus en plus en question l’authenticité des documents historiques. Chacune de ces publications dévalorise le travail des lieux de mémoire, des archives et des instituts de recherche et sape leur crédibilité.

Nous nous engageons en faveur d’un espace public numérique dans lequel les survivants de la persécution nazie et leurs descendants sont protégés contre l’instrumentalisation de leurs histoires personnelles par des inconnus, à des fins lucratives. Les sources historiques et la recherche scientifique ne doivent pas être supplantées par des contenus générés en masse par l’IA. Les voix authentiques et les perspectives diverses doivent être entendues.

Nous ne sommes pas opposés aux formes numériques de commémoration et de transmission. L’intelligence artificielle peut également être utilisée de manière tout à fait pertinente dans le cadre de l’éducation historique et politique. Cependant, le défi pour l’ensemble de la société consiste à développer des normes éthiques et historiquement responsables pour cette technologie. Les opérateurs de plateformes ont une responsabilité particulière à cet égard : ils doivent veiller à ce que la souffrance des victimes ne soit pas banalisée par des fictions émotionnelles.«

Nous appelons les exploitants de plateformes à :

- Agir de manière proactive contre les contenus IA qui déforment l’histoire. Et pas seulement après les signalements des utilisateurs.

- Signaler les contenus qui déforment l’histoire et sont trompeurs comme des informations erronées via les systèmes de signalement internes.

- Exclure de tous les programmes de monétisation les comptes qui diffusent de tels contenus.

- Signaler sans exception les contenus générés par l’IA et de les supprimer en cas de violation de l’obligation de signalement.

- Collaborer avec les lieux de mémoire, les archives et les experts afin d’améliorer les systèmes de détection des informations erronées relatives à l’Holocauste.

Premiers signataires (par ordre alphabétique), groupe de travail des mémoriaux des camps de concentration :

- Mémorial de Bergen-Belsen

- Mémorial de Buchenwald

- Mémorial du camp de concentration de Dachau

- Mémorial du camp de concentration de Flossenbürg

- Mémorial du camp de concentration de Mittelbau-Dora

- Mémorial du camp de concentration de Neuengamme

- Mémorial et lieu de commémoration de Ravensbrück

- Mémorial et musée de Sachsenhausen